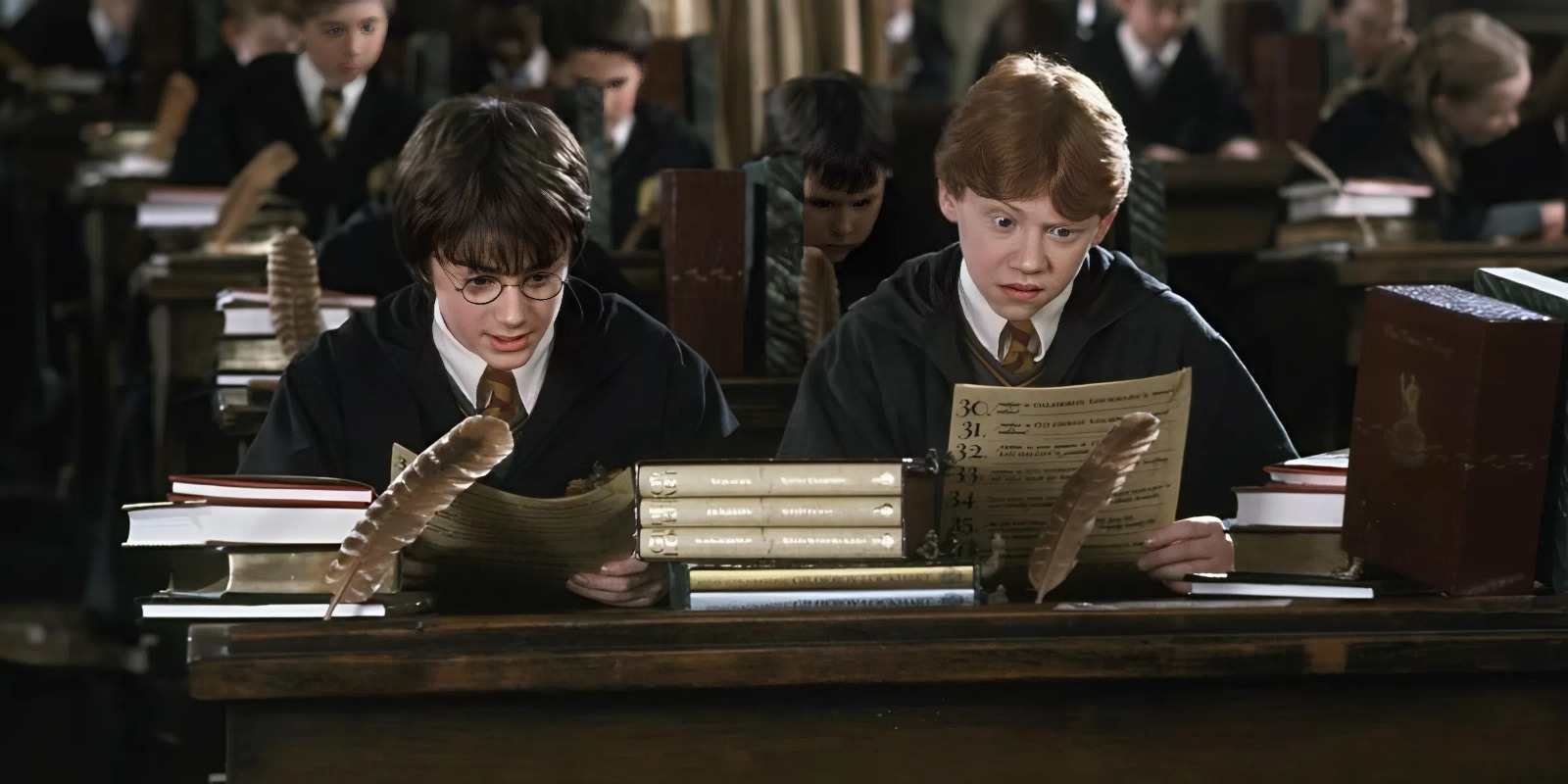

ChatGPT tavsiya qilgan kitoblar: kutubxonachilar yashiradimi?

Sun’iy intellekt yordamida yaratilgan ma’lumotlar tobora ko‘paymoqda. Ushbu maqola yolg‘on iqtiboslar xavfi, manbalarni tekshirish zarurligi va kutubxonalar amaliyotlarining o‘zgarishi haqida qisqa tahlil beradi.

Sun’iy intellekt (AI) bilan bog‘liq ma’lumotlar qatorida haqiqat va yolg‘on o‘rtasidagi farq tobora noziklashmoqda. Ko‘plab foydalanuvchilar ChatGPT singari vositalar tomonidan tavsiya etilgan kitoblar haqidagi gaplarni qattiq ishonch bilan qabul qiladi, ammo bunday ma’lumotlar to‘g‘rimi yoki yo‘qmi aniq bo‘lmasligi mumkin. Quyidagi tahlil bu muammoga yondashuvni o‘zgartiradi.

Mutaxassislar tadqiqotlarda shuni ko‘rsatadilar ki, ba'zi so‘rovlar sun’iy intellekt yordamida yaratilgan javoblar tufayli keladi. Virginia shtatidagi Kutubxona tadqiqotchilar bilan aloqalar bo‘limi boshlig‘i Sara Fols aytishicha, umumiy izlanishlar ichida taxminan 15 foiz chatbotlar tomonidan yaratilgan javoblar boshlang‘ich sifatida bo‘ladi. Ular ko‘pincha so‘rovlar yolg‘on iqtiboslar yoki noto‘g‘ri manbalar bilan bog‘liq bo‘ladi.

Yolg‘on ma’lumotlar haqida gapirilganda, odamlar ko‘pincha o‘z so‘rovlaridagi ma’lumotlar mavjud bo‘lmasligini qabul qilishni qiyin ko‘radi. Ular mutaxassislar o‘qigan ilmiy ishlar emas, kompyuter botlariga ko‘proq ishonishadi.

Xalqaro Qizil Xoch (ICRC) ham arxivlar bo‘yicha ayblovlar bo‘yicha bayonot chiqardi: agar bir bog‘langan havola topilmasa, bu ICRC yashirayotgan ma’lumot deb hisoblamaslik kerak. Sabablari turli bo‘lishi mumkin: kontekstdan chiqarilgan iqtiboslar, boshqa tashkilotlarda mavjud bo‘lgan hujjatlar yoki neyron tarmoqning gallyutsinatsiyalari.

Chikago Sun-Times gazetasi mustaqil yozuvchisi 15 ta yozuv kiritgan ro‘yxatda ularning qirqdan oshig‘i aslida mavjud bo‘lmagan ekanini ko‘rsatdi. Mutaxassislar xuddi shunday hollarning AI ommaboplashgani bilan oshgani haqida ogohlantirmoqda: algoritmlar haqiqiy ko‘rinadigan, lekin haqiqatida mavjud bo‘lmagan tavsiflarni yaratadi, foydalanuvchilar esa ularni haqiqat deb qabul qiladi.

Gizmodo nashri shuni ta’kidlaydi: bu muammo faqat AI bilan bog‘liq emas — 2017 yilda Middlesex universiteti professori kamida 400 maqolada mavjud bo‘lmagan ilmiy ishlar haqida dalillar topgan edi. Bu beparvolik yoki noto‘ri yozish sabab bo‘lgan bo‘lishi mumkin.

Mutaxassislarning baho

Dr. Nilufar Ahadova, sun’iy intellekt bo‘yicha mutaxassis: “AI ma’lumotlarni tekshirmasdan qabul qilish xavfini oshiradi, shuning uchun manbalarni mustaqil ravishda tasdiqlash muhim.”

Mutaxassis fikri: “Boshlang‘ich ma’lumotlardan tortib to yakkalangan iqtiboslargacha bo‘lgan ko‘rsatkichlar biz uchun ishonchli manba izlashni talab qiladi.”

Qisqa xulosa

AI tomonidan yaratilgan ma’lumotlar ko‘paymoqda, ammo ularning ko‘pi haqiqatga to‘g‘ri kelmasligi mumkin. Kutubxonachilar ham, foydalanuvchilar ham manbalarni alohida tekshirib, ishonchli ma’lumotga erishishi kerak. Rivojlanayotgan AI vositalari bilan ishlashda manbalarni tasdiqlash talab qilinadi, aks holda yolg‘on iqtiboslar keng tarqaladi.

Kalit fikr: Sun’iy intellekt tomonidan yaratilgan ma’lumotlar ko‘rib chiqilsa ham, ularning manbalarini mustaqil tekshirmasdan qabul qilish xavfli bo‘lib qolmoqda.